Masz ChatGPT. Odpowiada na pytania, pisze maile, generuje pomysły. Świetne narzędzie. Ale nadal musisz go karmić kontekstem, poprawiać halucynacje i ręcznie kopiować wynik do właściwego miejsca. To nie jest asystent. To szybszy Google z lepszą gramatyką.

Tymczasem branża obiecuje „agentów AI" — autonomiczne systemy, które same planują, wykonują i weryfikują zadania. Gartner przewiduje, że do końca 2026 roku 40% aplikacji enterprise będzie miało wbudowanych agentów AI. Skok z mniej niż 5% w 2025. Brzmi jak rewolucja. Ale czy naprawdę?

Key Takeaways:

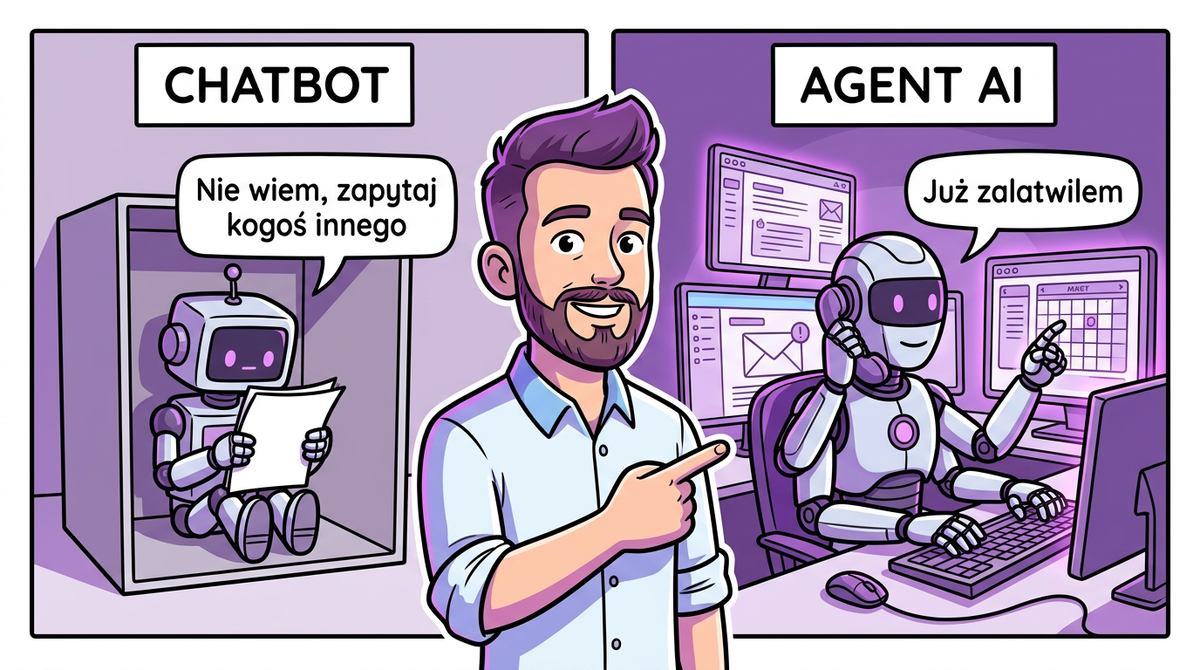

- Chatbot odpowiada na pytania. Agent AI realizuje cele autonomicznie — planuje, używa narzędzi, weryfikuje wyniki

- 40% projektów agentów AI zostanie porzuconych do 2027 roku (Gartner) — głównie przez brak nadzoru i halucynacje

- W testach wielokrokowych zadań agenci AI mylą się w 70% przypadków

- 93% liderów IT planuje wdrożyć agentów w ciągu 2 lat — ale tylko 5% systemów GenAI dociera do produkcji

- Agent AI ma sens tam, gdzie zadanie jest powtarzalne, zdefiniowane i odwracalne. Reszta to marketing

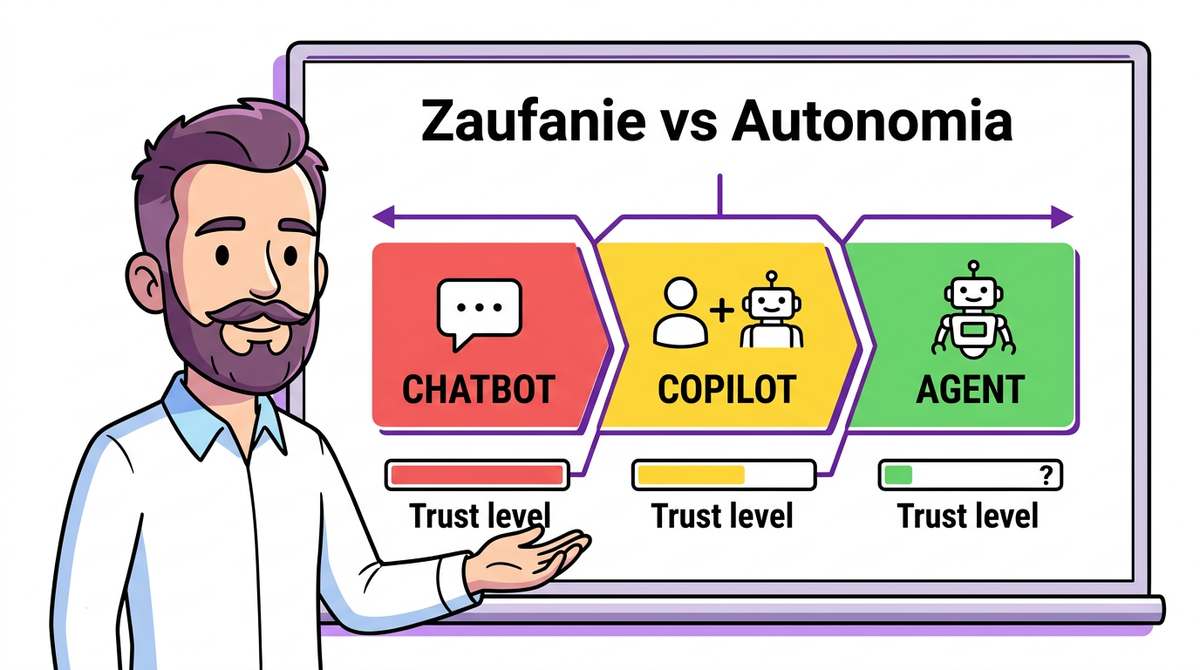

Chatbot, copilot, agent — trzy różne zwierzęta

Zanim ocenisz, czy agent AI zastąpi Twojego asystenta, ustalmy o czym mówimy. Bo branża celowo miesza te pojęcia.

Chatbot odpowiada na pytania. Reaktywnie. Ty piszesz, on odpowiada. Nie ma pamięci między sesjami, nie podejmuje decyzji, nie wykonuje akcji poza oknem czatu. Jak ujmuje to Cognigy: „Chatbot zaczyna każdą sesję od zera. Nie pamięta, że klient dzwonił wczoraj z tym samym problemem".

Copilot to chatbot z kontekstem. Widzi Twój ekran, Twoje pliki, Twojego maila. Sugeruje, ale Ty decydujesz. GitHub Copilot, Cursor, Microsoft Copilot — to ta kategoria.

Agent AI to fundamentalnie coś innego. Dajesz mu cel. On sam planuje kroki, używa narzędzi (API, bazy danych, przeglądarki), wykonuje akcje i weryfikuje wyniki. Działa w pętli: zaplanuj → wykonaj → oceń → popraw. IBM definiuje agentów AI jako systemy zdolne do autonomicznego podejmowania decyzji i działania w ramach wyznaczonych granic.

93% liderów IT chce agentów. 5% systemów GenAI dociera do produkcji

Rozbieżność między ambicjami a rzeczywistością jest kolosalna. 93% liderów IT deklaruje zamiar wdrożenia autonomicznych agentów w ciągu dwóch lat. Jednocześnie raport MIT pokazuje, że zaledwie 5% systemów generatywnej AI klasy enterprise dociera do produkcji. Dziewięćdziesiąt pięć procent odpada w fazie ewaluacji.

Dlaczego? Bo demo to nie produkcja. Agent, który na prezentacji rezerwuje lot i hotel, w realnym świecie halucynuje numer lotu, rezerwuje hotel w złym mieście i wysyła potwierdzenie do niewłaściwej osoby. A Ty dowiadujesz się o tym na lotnisku.

Ze słownika Noraline: Pętla agentowa (Agent Loop) — fundamentalny mechanizm agenta AI: zaplanuj krok → wykonaj → oceń wynik → zdecyduj co dalej. W odróżnieniu od chatbota (pytanie→odpowiedź), agent działa w cyklach. Problem: każdy cykl to kolejna szansa na halucynację. Im więcej kroków, tym większe ryzyko kaskadowego błędu.

70% błędów w zadaniach wielokrokowych. Matematyka jest bezlitosna

Oto statystyka, która powinna schłodzić entuzjazm: w symulowanych środowiskach biurowych, agenci AI oparte na LLM wykonują zadania wielokrokowe błędnie w niemal 70% przypadków. Siedemdziesiąt procent.

Dlaczego tak dużo? Bo agent to łańcuch decyzji. Jeśli każda decyzja ma 90% szans powodzenia, a zadanie wymaga 10 kroków: 0.9^10 = 35% szansy na sukces całości. Przy 20 krokach: 12%. Matematyka jest brutalna.

Dodaj do tego halucynacje. Badanie Stanforda pokazuje, że nawet zaawansowane narzędzia prawnicze oparte na AI halucynują w 17-33% przypadków. Gdy agent działa na sfałszowanym fakcie — podejmuje realne decyzje na podstawie zmyślonej informacji. I nikt tego nie złapie, bo cały sens agenta polega na tym, że działa sam.

40% projektów agentów AI zostanie porzuconych. Oto dlaczego

Gartner prognozuje, że ponad 40% projektów agentów AI zostanie porzuconych do 2027 roku. Raport Dynatrace dodaje, że 70% regulowanych przedsiębiorstw przebudowuje swój stos agentów AI co trzy miesiące — albo częściej.

Główne przyczyny porażek? Nie technologia. Organizacja.

Brak nadzoru. Firmy dają agentom zbyt dużą autonomię zbyt szybko. Agent, który sam wysyła maile do klientów bez weryfikacji człowieka? Przepis na katastrofę PR-ową.

Brak granic. Agent bez jasno zdefiniowanych uprawnień to jak pracownik z dostępem administratora do wszystkiego. Pytanie nie brzmi „czy" coś zepsuje, ale „kiedy".

Brak mierników. Jak oceniasz, czy agent „dobrze" zrobił zadanie? Jeśli nie masz KPI przed wdrożeniem, nigdy nie zmierzysz ROI.

Kiedy agent AI naprawdę ma sens?

Agent nie jest odpowiedzią na wszystko. Jest odpowiedzią na konkretną kategorię problemów. Oto filtr:

Zadanie jest powtarzalne. Codziennie robisz to samo? Sprawdzasz te same źródła, generujesz ten sam typ raportu, wysyłasz ten sam format maila? Agent to zrobi. Pisałem o tym w kontekście przejmowania żmudnych czynności — agent to kolejny poziom.

Zadanie jest zdefiniowane. Jasne wejście, jasne wyjście, jasne kryteria sukcesu. „Przygotuj raport sprzedażowy z CRM za ostatni tydzień" — tak. „Wymyśl strategię marketingową" — absolutnie nie.

Błąd jest odwracalny. Agent wysłał zły draft maila? Poprawisz. Agent złożył zamówienie za 50 000 zł u złego dostawcy? Problem. Zacznij od zadań, gdzie pomyłka kosztuje minuty, nie pieniądze.

Jest człowiek w pętli. Przynajmniej na początku. Agent przygotowuje — człowiek zatwierdza. Z czasem, gdy zbudujesz zaufanie (i dane potwierdzą niezawodność), możesz zwiększać autonomię.

80 miliardów dolarów do 2030. Ale komu to się opłaci?

Rynek agentów AI ma wzrosnąć z ~15 miliardów dolarów w 2025 do 80-100 miliardów do 2030. 79% organizacji deklaruje, że „wdrożyło agentów AI w jakimś stopniu". Cztery na pięć firm. Brzmi imponująco?

„W jakimś stopniu" to klucz. Pilot na 3 osoby w dziale marketingu to „wdrożenie w jakimś stopniu". Prawdziwe pytanie: ile z tych wdrożeń generuje mierzalny ROI? Dane na ten temat są zdecydowanie mniej imponujące niż nagłówki.

IBM w raporcie „Expectations vs. Reality" wprost pisze: przepaść między oczekiwaniami a rzeczywistością w agentach AI jest największa ze wszystkich technologii, które badali. Nie dlatego, że technologia nie działa. Dlatego, że oczekiwania są kosmiczne.

Copilot zamiast agenta: mądrzejsza ścieżka dla większości firm

Herezja? Może. Ale posłuchaj argumentu.

Copilot daje Ci 80% korzyści agenta przy 20% ryzyka. Sugeruje, ale nie działa sam. Przyspiesza, ale nie podejmuje decyzji za Ciebie. Halucynuje? Łapiesz to, bo widzisz sugestię przed zatwierdzeniem.

Dla firmy, która jeszcze nie ma zmapowanych procesów, nie ma KPI i nie ma kultury mierzenia wyników — wdrażanie autonomicznego agenta to jak automatyzacja zepsutego procesu. Szybciej i na większą skalę.

Droga: copilot → agent z nadzorem → agent autonomiczny. Każdy krok wymaga udowodnienia, że poprzedni działa. Zero skrótów.

Przyszłość: agenci jako członkowie zespołu

Gartner przewiduje, że do 2028 roku 38% organizacji będzie miało agentów AI jako formalnych członków zespołów ludzkich. Nie narzędzia — członków zespołu. Z przydzielonymi zadaniami, odpowiedzialnością i miernikami wydajności.

Czy to się stanie? Prawdopodobnie. Ale nie w 2026. Nie w większości firm. I nie bez bolesnej nauki na błędach pierwszych wdrożeń.

Na dziś, realistyczna rada: użyj ChatGPT/Claude jako copilota. Zmapuj jeden powtarzalny proces. Zbuduj agenta z nadzorem człowieka. Zmierz wyniki przez miesiąc. Dopiero potem zwiększaj autonomię. I nie bój się zabić projektu, jeśli dane mówią, że agent nie dowozi.

Chcesz wdrożyć agenta AI, ale nie wiesz od czego zacząć? Napisz: AUDYT — przejdziemy przez Twoje procesy i wskażemy te, gdzie agent naprawdę zarobi na siebie.

Najczesciej zadawane pytania

Chatbot reaguje na pytania — Ty piszesz, on odpowiada, nie pamięta poprzednich sesji i nie podejmuje działań poza oknem czatu. Agent AI realizuje cele autonomicznie: sam planuje kroki, używa narzędzi (API, bazy danych, przeglądarki), wykonuje akcje i weryfikuje wyniki w pętli. Różnica jak między kalkulatorem a księgowym — jeden liczy, drugi prowadzi firmę.

Nie w pełni. W testach wielokrokowych zadań agenci AI mylą się w niemal 70% przypadków. Nawet zaawansowane narzędzia oparte na LLM halucynują w 17-33% przypadków. Gartner przewiduje, że ponad 40% projektów agentów AI zostanie porzuconych do 2027 roku. Technologia działa — ale wymaga nadzoru człowieka i dobrze zdefiniowanych granic działania.

Agent AI ma sens gdy zadanie jest powtarzalne (codzienna rutyna), zdefiniowane (jasne wejście, wyjście i kryteria sukcesu), a błąd jest odwracalny (pomyłka kosztuje minuty, nie pieniądze). Dodatkowo na początek powinien być człowiek w pętli zatwierdzający wyniki. Przykład: automatyczny raport sprzedażowy z CRM — tak. Strategia marketingowa — nie.

Rynek agentów AI szacowany jest na 12-15 miliardów dolarów w 2025 roku z prognozą wzrostu do 80-100 miliardów do 2030. 88% kadry zarządzającej planuje zwiększyć budżety na AI w ciągu najbliższych 12 miesięcy. Jednak realne ROI trudno zmierzyć — 79% firm deklaruje wdrożenie agentów, ale większość to pilotażowe projekty na małą skalę.

Dla większości firm w 2026 — tak. Copilot daje 80% korzyści agenta przy 20% ryzyka. Sugeruje, ale nie działa sam, więc halucynacje łapiesz przed zatwierdzeniem. Rekomendowana ścieżka: zacznij od copilota, zmapuj procesy, zbuduj agenta z nadzorem człowieka, zmierz wyniki przez miesiąc, dopiero potem zwiększaj autonomię. Zero skrótów.

Trzy kluczowe przyczyny: brak nadzoru (zbyt duża autonomia zbyt szybko), brak granic (agent bez zdefiniowanych uprawnień), brak mierników (brak KPI przed wdrożeniem). 95% systemów generatywnej AI klasy enterprise nie dociera do produkcji. Problem nie jest technologiczny — jest organizacyjny. Firmy wdrażają agentów bez zmapowania procesów i bez kultury mierzenia wyników.

Szymon Mojsak

Ekspert automatyzacji procesów biznesowych oraz specjalista ds. HR z wieloletnim doświadczeniem w wdrażaniu zaawansowanych rozwiązań IT w obszarze zarządzania zasobami ludzkimi. Jako współwłaściciel RCPonline, lidera rynku systemów rejestracji czasu pracy, łączy dogłębną wiedzę technologiczną ze zrozumieniem wymogów prawnych oraz specyfiki branży HR. Regularnie tworzy treści i analizy w oparciu o aktualne standardy branżowe, koncentrując się na bezpieczeństwie, skuteczności i transparentności procesów, co przekłada się na realną wartość dla klientów biznesowych.

→ Więcej o autorze

Ładowanie komentarzy...